離譜!亞馬遜Alexa誘導10歲女孩玩致命遊戲!

細思恐極啊……

隨著科學技術的發展,越來越多先端技術被引進人們的生活,AI人工智慧技術也不例外,只要對著設備說出指令,AI助手就能幫你打開家裡智能電器的開關,或者回答你的問題。

因此也產生了各種各樣的AI助手,比如iPhone的Siri,Google的Google Assistant……還有亞馬遜Echo音箱AI助手Alexa。

而人們也很擔心,這些擁有智慧的無機生命體會不會哪一天就像科幻電影一樣,不滿足於服從人類的指令,開始反噬?

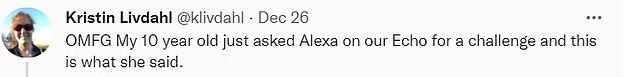

近日,美國一名母親在推特上曝光了一件事震驚了所有人:她家的Alexa差點殺死了自己10歲的女兒!

事情發生在上周日Boxing Day,克里斯汀·利達爾(Kristin Livdahl)跟10歲的女兒在家。

因為外面天氣非常糟糕,於是母女倆打開Youtube,跟著一位體育老師做了一些挑戰遊戲。

她說:「我們做了一些身體挑戰,比如躺下,用腳踩著一隻鞋翻身。」

之後女兒覺得沒有玩夠,於是向家裡的Echo音箱問Alexa能不能再找一個挑戰遊戲給她。

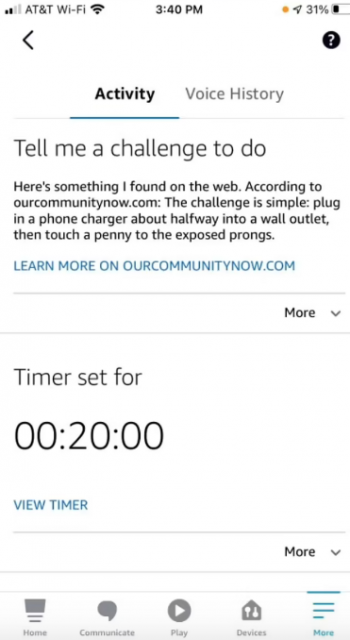

於是Alexa搜索完之後,這樣回復了她:「把手機充電器插到牆上插座的一半,然後用一分錢摸一下暴露在外面的尖頭。」

媽媽Kristin大驚失色,當時立刻大喊:「不,Alexa,不!」

這麼做很容易發生事故,10歲的女兒差點就沒命了……

事後,Kristin把這件事發上了推特,引起了廣泛的關注。

據了解,Alexa是通過互聯網搜索到的一篇文章里選的這個挑戰遊戲,而非常諷刺的是,這篇文章中講的內容是父母反對孩子參加去年在TikTok上瘋傳的「硬幣挑戰」。

也就是將充電器僅插入一部分到牆上,然後用硬幣去觸碰露出的尖頭來製造火花。

這個挑戰遊戲到底有多危險呢?坎布里亞郡卡萊爾的消防站經理邁克爾·克拉斯克(Michael Clusker)說,這個遊戲很可能會導致參與者死亡。

「這樣做的結果是有人會受到嚴重傷害,每年都有很多人死於電擊。如果你真的按照這個玩法做了,它可能會殺了你。

「任何干擾電氣設備的東西都是非常危險的,除非你是一個合格的電工。」

之前就有一位男生把一枚硬幣掉在了插在插座上的iPhone充電器的尖頭上後,導致消防隊員不得不迅速衝去學校……

Clusker強烈抨擊這個遊戲,表示從社交媒體中獲得靈感的青少年需要負更多責任。

他說:「我確實認為社交媒體是個問題,它給人們帶來的想法可能並不理想,但人們應該為自己的行為負責。」

而Alexa竟然誘導10歲女孩玩這個致命的挑戰遊戲,幸虧母親在場,否則後果不堪設想。

事發之後,亞馬遜立刻出來道歉,並說已經更新了助手,表示這個Bug被修復了,以後不會再發生這個情況。

亞馬遜在聲明中說道:「客戶信任是我們所做的一切的核心,Alexa旨在為客戶提供準確、相關和有用的信息。」

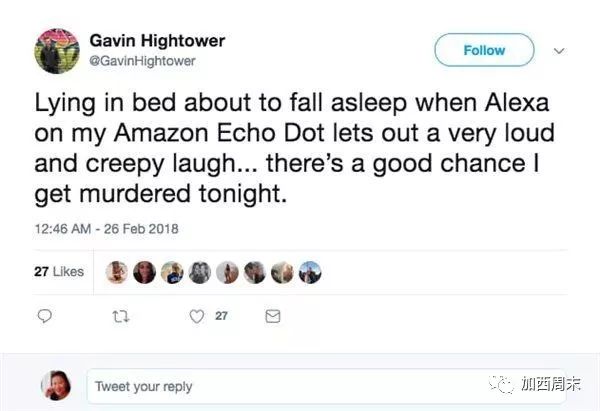

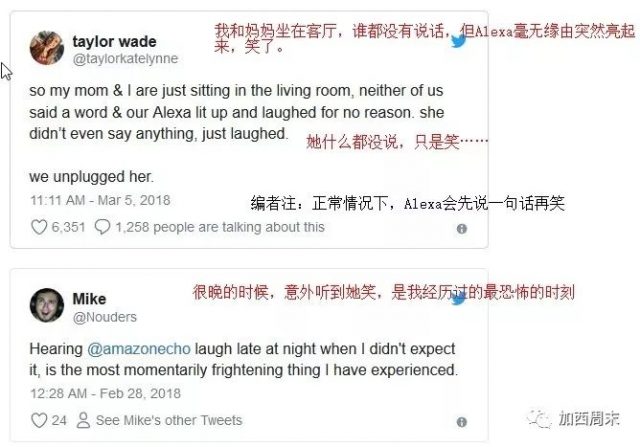

但其實早在2018年,Alexa就已經出過事了;大概在18年3月份的時候,全世界的Alexa曾經集體行為失控過……

就比如這位網友在推特上講出了自己驚悚的經歷:

「躺在床上都快睡著了,我家亞馬遜Echo Dot配置的Alex突然發出一陣超大聲、超驚悚的大笑……我很有可能今晚被謀殺。」

更可怕的……還有另一名用戶在睡前命令Alexa關燈,但她不停地關燈、開燈、關燈、開燈……

重複三次後,Alexa竟然發出了「像女巫一樣」惡毒的笑聲……

還有一個用戶說,他在詢問Alexa第二天計劃時,Alexa說到一半突然停了下來,然後開始隨機做事情;

這位用戶嚇壞了,趕緊給Alexa下了一個放音樂的簡單指令,結果Alexa彷彿沒聽見,居然開始給他解釋「Please」的意思,似乎是要求他使用禮貌用語……

他一下變得很恐慌,說「Alexa你嚇到我了!」,然後,Alexa開始發出讓他冷汗直流的可怕笑聲。

還有更可怕的故事,另外一位用戶說,他們晚上回到家後,根本沒有下任何指令,Alexa卻開始自言自語!

再加上這次Alexa誘導10歲女孩玩致命遊戲的事件……

雖然這次事件因為監護人在場沒有發展成悲劇,並且亞馬遜及時出來修復了bug,但是很多人都說Alexa的反應細思恐極:這會不會是一個人工智慧準備屠殺人類的前兆……?